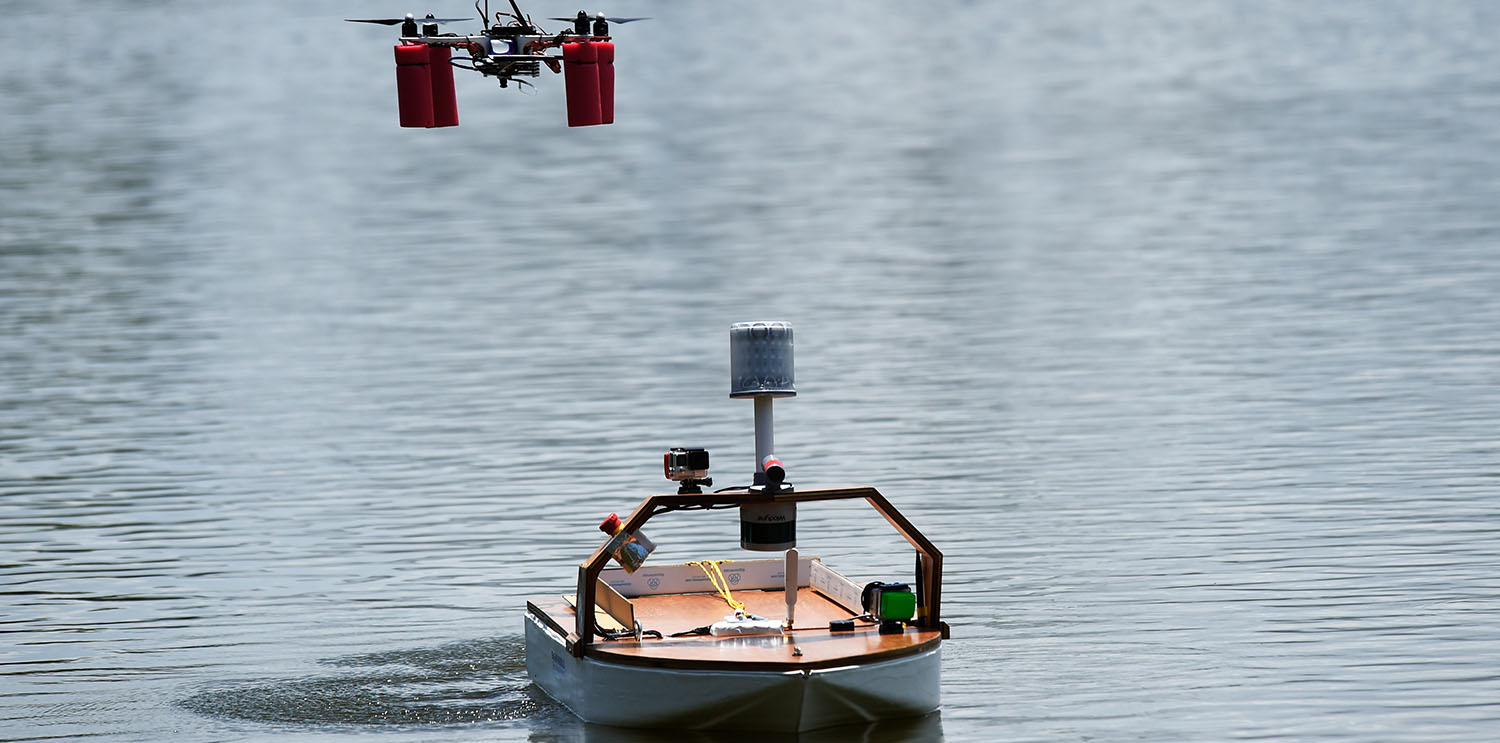

Durch moderne Kommunikations- und Informationstechnik werden unbemannte oder autonome Waffensysteme auch auf See möglich. Vor dem Einsatz sind jedoch noch vielfältige Fragen zu beantworten.

Wahrnehmungen und Erwartungen zum Thema technische Systeme, die eigenständig handlungsfähig sind, werden spätestens seit 1984 nachhaltig geprägt vom „Terminator“ und von der dahinter agierenden technischen Intelligenz „Skynet“. Ein Maschinenstaat mit nahezu unlimitierten Fähigkeiten, die nur noch übertroffen werden von seinem Willen zur Macht, grenzenloser Amoralität und Feindschaft zur Menschheit. Wenn von autonomen Systemen die Rede ist, werden Bilder und Story vom Terminator beinahe automatisch mitgedacht. Die technologische Realität hebt sich davon deutlich ab. Zwar fliegen Drohnen um die halbe Welt, Panzer und Schiffe ohne Besatzung bewachen militärische Anlagen oder suchen nach U-Booten und schließlich gehören IT-gestützte Führungs- und Waffeneinsatzsysteme schon lange zum militärischen Alltag – all das geschieht aber unter Steuerung oder enger Aufsicht durch Soldaten. Der Beitrag verbindet den technologischen Stand und die Aussichten auf künftige Entwicklungen mit ausgesuchten Fragen des Völkerrechts und der Ethik. Er basiert auf den Ergebnissen der Abhandlung „Unbemannte Systeme und Cyberoperationen: Streitkräfte und Konflikt im 21. Jahrhundert – Eine Einführung“.

Beispiele für Waffensysteme

Nachfolgend nur einige Vergleichsobjekte aus der enorm großen globalen Auswahl, alle lassen sich mit Web-Suchmaschinen finden:

- „Zaunkönig“, Torpedo der Kriegsmarine, seit September 1943 im Einsatz: weltweit erster eigenständig akustisch zielsuchender Torpedo, eingesetzt von U-Booten.

- AGM-158C LRASM (Long Range Anti Ship Missile), unterschallschneller Seezielflugkörper: konzipiert für die Verwendung gegen Überwasserziele auf größere Entfernungen; bekommt ein Suchgebiet und eines oder mehrere Ziele zugewiesen und kann im Zielanflug eine Auswahl unter zugewiesenen Zielen treffen.

- Harpy: Drohne, Anti-Radiation Loitering Munition System, konzipiert zur Bekämpfung von bodengestützten Luftabwehrradarsystemen. Wird von einem Lkw gestartet und kreist mehrere Stunden über einem zugewiesenen Operationsgebiet; erfasst es die Radarstrahlung eines bodengestützten Luftabwehrsystems, stürzt es sich in diese Quelle und zerstört sie.

- MQ-9 Reaper: Drohne zur Aufklärung und Bekämpfung von Bodenzielen mit großer Reichweite, wird entweder ferngesteuert oder kann optional einen programmierten Auftrag eigenständig durchführen.

- Black Hornet PRS: Das Kontrastprogramm zu großen Drohnen sind Nano-Systeme, die als Personal Reconnaissance System des Infanteristen Verwendung finden; Mit seinen 17 Zentimetern Länge bei 33 Gramm Gewicht bleibt es rund 25 Minuten in der Luft und kann auch Innenräume aufklären.

- Airbus VSR 700: als unbemannter Helikopter mittlerer Größe bietet der VSR 700 eine Vielfalt an Einsatzmöglichkeiten; Mit 700 Kilo Gesamtgewicht, 150 Kilo Zuladung und zehn Stunden Flugdauer der ideale unbemannte „Bordhubschrauber“ für Korvetten und Fregatten mit den Optionen Aufklärung und Wirkung.

- Future Combat Air System (FCAS): Deutschland, Frankreich und Spanien wollen bis Ende 2021 eine erste Technologiedemonstration für die Kombination aus einem Kampfflugzeug als Nachfolger des Eurofighter und Drohnen, die als „Wingmen“ des Kampfflugzeugs einen Fähigkeitsverbund für Aufklärung, Führung und Wirkung herstellen sollen. Das System soll ab etwa 2040 von den Streitkräften genutzt werden können.

- Protector und Seagull: unbemannte, rund neun bis zwölf Meter lange Kampfboote zur Überwachung von Küstengewässern, Häfen, Reeden und Flüssen, die ferngesteuert oder im automatischen Modus Ziele bekämpfen können. Ausstattung wahlweise mit Maschinengewehren, Granatwerfern, Minenjagdausrüstung oder ASW-Torpedos. Den Einsatz kann man sich singulär, aber auch als Wingmen für bemannte Boote vorstellen, etwa zur Absicherung von Spezialkräften in amphibischen Operationen. Ein Teil der Ausstattung der Fregatten der Klasse 125 mit Kampfbooten könnten solche USV sein.

- Sea Hunter, unbemanntes U-Jagd Schiff der US Navy, 10 000 Seemeilen Reichweite, 90 Tagen Seeausdauer, kann ferngesteuert werden oder im automatischen Modus operieren. Die PRC projektiert den Bau von unbemannten U-Booten, die vergleichbar lange getaucht operieren sollen.

- Große UUVs (Unmanned Underwater Vehicles): Boeings Echo Voyager war 2017 in einem Test drei Monate lang getaucht unterwegs, die US Navy hat fünf Exemplare des Nachfolgers Orca bestellt; die chinesische Marine soll in den Zwanzigerjahren ein UUVs bekommen, die ebenfalls monatelang getaucht operieren können; Russland entwickelt „Torpedos“ mit nuklearem Antrieb und Sprengkopf, Reichweite 10 000 Meilen, die von dem rund 30 000 Tonnen verdrängenden U-Boot Belgorod eingesetzt werden sollen; die Waffe könnte nach dem Absetzen vom Mutterschiff monatelang „auf der Lauer liegen“.

Alle Systeme operieren entweder ferngesteuert oder auf Basis von vorprogrammierten Zielzuweisungen und Abläufen. Allein Starts und Landungen, der Transfer ins Operationsgebiet oder vorprogrammierte Notabläufe wie „Lost-Link Mode“ laufen ohne den Eingriff von Soldaten ab.

Keine „autonomen“ Systeme

Die beste Grundlage zur Einordnung von Systemen als autonom oder als lediglich automatisiert liefert die britische „Joint Doctrine Publication 0-30.2 Unmanned Aircraft Systems“, die die Besonderheiten unbemannter fliegender Systeme beschreibt und vor allem erkennbar macht, was aktuelle Systeme nicht können. Differenziert wird in zwei Kategorien.

Danach gilt als „Automated System“: „… an automated or automatic system is one that, in response to inputs from one or more sensors, is programmed to logically follow a predefined set of rules in order to provide an outcome. Knowing the set of rules under which it is operating means that its output is predictable.”

Und als „Autonomous System”: „An autonomous system is capable of understanding higher-level intent and direction. From this understanding and its perception of its environment, such a system is able to take appropriate action to bring about a desired state. It is capable of deciding a course of action, from a number of alternatives, without depending on human oversight and control, although these may still be present. Although the overall activity of an autonomous unmanned aircraft will be predictable, individual actions may not be.”

Diese Definition hat indes eine Schwäche: Systeme, die vom Menschen überwacht und jederzeit beeinflusst oder gestoppt werden können, sind nicht autonom. Der ursprüngliche Begriff Autonomie beschreibt eine Eigenschaft des Menschen als Zustand der Selbstbestimmung durch Entscheidungs- und Handlungsfreiheit. Die Definition zum autonomen System in diesem Sinne bedarf also einer Ergänzung: Autonomie beginnt erst, wenn ein System seine Handlung unabhängig vom Menschen beginnen und beenden kann, der Mensch also keinerlei Eingriffsmöglichkeit in die Systemhandlung hat.

Der Zaunkönig ist daher ein automatisiertes System, weil die Einsatzentscheidung beim Menschen liegt und zweitens wegen der Bindung an das mechanisch festgelegte Handlungsprogramm. LRASM oder Harpy exerzieren ebenfalls vorprogrammierte Optionen durch, wenn auch auf einem technologisch höheren Niveau – sie treffen keine eigenen Entscheidungen, auch wenn sie im Operationsgebiet unabhängig vom Operator ihre Aufgabe ausführen. Anders formuliert: Eigenständiges Operieren genügt nicht für Autonomie, wenn das System allein seinen mechanischen Zwängen oder Algorithmen folgt, denn es hat keinerlei Entscheidungsfreiheit. Etliche der oben genannten Systeme werden vom Menschen ferngesteuert. Genügt es für das Prädikat „autonom“, wenn es für das System keine Abschaltfunktion gibt, keine Option, durch Eingriff des Operators die Mission abzubrechen? Selbst dann ganz klar nein, wenn das System einer Programmierung folgt und keine Ausbruchsoption aus dem vorprogrammierten Rahmen hat.

Die oben erwähnten militärischen Systeme fallen komplett in die Kategorie „automatisiert“. Für alle oben aufgezählten Systeme gilt: Im automatischen Modus realisieren sie lediglich programmierte Absichten im konkreten Einzelfall auf Befehl des Menschen. Keines von den oben untersuchten Systemen ist ein autonomes System im oben definierten Sinne. Daher ist es geboten, die Systeme als „unbemannte Systeme“ zu bezeichnen, da dies die einzige allen Systemen gemeinsame Eigenschaft darstellt.

Humanitäres Völkerrecht

Das Humanitäre Völkerrecht (HVR) bindet die Konfliktparteien und alle für sie handelnden Personen. Die Vielzahl der Rechtsgrundlagen findet sich unter anderem im Viadrina International Law Project (VILP). An den wichtigsten vier Regeln des HVR, unter Abstützung auf deren leicht verständliche Formulierung auf der Website des Auswärtigen Amtes, wird die rechtliche Seite des Einsatzes automatisierter Systeme erläutert.

Regel 1: Weder die Konfliktparteien noch die Angehörigen ihrer Streitkräfte haben uneingeschränkte Freiheit bei der Wahl der zur Kriegführung eingesetzten Methoden und Mittel. So ist der Einsatz jeglicher Waffen und Kampfmethoden verboten, die überflüssige Verletzungen und unnötige Leiden bewirken.

Zu den verbotenen Mitteln und Methoden gehören beispielsweise Giftgas, Laser zur dauerhaften Erblindung, Munition zur Erzeugung zusätzlicher Leiden über die militärisch erforderte Wirkung zur Verletzung und Tötung hinaus und Terrorangriffe gegen die Zivilbevölkerung. Rechtsgrundlage ist Artikel 35 des Zusatzprotokolls Nr. 1 zu den Genfer Abkommen. Der Gebrauch von Maschinen an sich verstößt nicht gegen diese Regeln, es kommt auf den konkreten Einsatz und die verwendete Munition an. Setzt der Operator Drohnen für einen Terrorangriff allein gegen unbeteiligte Zivilisten ein oder verschießt die Drohne verbotene Munition, liegt ein Verstoß gegen das HVR vor. Es macht keinen Unterschied, ob die Drohne ferngesteuert wird oder den Angriff aufgrund der Programmierung ohne Eingriff des Operators durchführt.

Regel 2: Zum Zwecke der Schonung der Zivilbevölkerung und ziviler Objekte ist jederzeit zwischen Zivilbevölkerung und Kombattanten zu unterscheiden. Weder die Zivilbevölkerung als Ganzes noch einzelne Zivilisten dürfen angegriffen werden. Angriffe dürfen ausschließlich auf militärische Ziele gerichtet sein.

Wie ist es zu beurteilen, wenn Harpy eine gegnerische Radarstellung angreift, die inmitten einer dicht besiedelten Ortschaft postiert ist? Die Radarstellung ist ein legitimes militärisches Ziel. Der Angriff erfolgt nicht ausschließlich und nicht primär gegen die Zivilbevölkerung, deshalb ist der Angriff auf die Radarstellung zulässig, solange keine exzessiven Kollateralschäden erzeugt werden. Das folgt aus den Artikeln 35, 51 und 57 des Zusatzprotokolls Nr. 1 zu den Genfer Abkommen. Es gibt keinen Unterschied in der rechtlichen Beurteilung gegenüber dem Piloten eines Kampfflugzeugs, der sich zum Schutz seiner selbst und der weiteren eingesetzten eigenen Einheiten ebenfalls für den Flugkörpereinsatz gegen das im Wohngebiet aufgestellte feindliche Radarsystem entscheiden müsste, auch wenn dabei Zivilisten umkommen können. Präzision ist als Mittel zur Verminderung der Zahl ziviler Opfer schon seit Jahrzehnten wirksam, vor Einführung der zielsuchenden Flugkörper hätte man zur sicheren Ausschaltung einer Radaranlage einen größeren Umkreis mit Bomben oder Granaten eindecken müssen. Die Situation erfordert zudem den Blick auf die Gegenseite: Es liegt eine Verletzung von Regel 1 auf Seiten der Partei, die ihre Radarstellung in einem Wohnviertel positioniert und damit die zivile Bevölkerung als menschliche Schutzschilde instrumentalisiert. Verletzt werden die Artikel 48 und 58 lit. b) des Zusatzprotokolls Nr. 1 zu den Genfer Abkommen. Die Positionierung der Radarstellung inmitten der zivilen Bevölkerung erschwert dem Gegner die Unterscheidung und Absonderung dieses militärischen Ziels von anderen nicht legitimen Zielen – man kann auch das als Kampfmethode qualifizieren, die zu überflüssigen Verletzungen, Tötungen und unnötigen Leiden führen kann.

Regel 3: In der Gewalt einer gegnerischen Partei befindliche Kämpfer und Zivilisten haben Anspruch auf Achtung ihres Lebens und ihrer Würde. Sie sind vor jeglichen Gewalthandlungen oder Repressalien zu schützen.

Gewahrsam wird durch Soldaten ausgeübt, derzeit haben unbemannte Systeme nicht die Eignung für diese Aufgabe.

Regel 4: Es ist verboten, einen Gegner, der sich ergibt oder zur Fortsetzung des Kampfes nicht in der Lage ist, zu töten oder zu verletzen.

Rechtsgrundlage ist unter anderem Artikel 41 des Zusatzprotokolls Nr. 1 zu den Genfer Abkommen. Dem Anspruch auf Schutz der außer Gefecht befindlichen Gegner müssen Maschinen ebenso wie Soldaten genügen können, jedenfalls, wenn sie ohne Mitwirkung des Operators tätig werden – was aber wegen der derzeitigen Beschränkungen der Wahrnehmungsfähigkeit technischer Systeme wohl nicht in Bälde zuverlässig abzubilden sein wird. Beim Kampf auf See ist es aufgrund der großen Gefechtsentfernungen auch für Menschen schwierig zu erkennen, dass ein gegnerisches Schiff aufgestoppt ist, allein um den Ausstieg der Besatzung zu ermöglichen. An fernsteuernde Operatoren oder Programmierer technischer Systeme können keine höheren Ansprüche gestellt werden als an die Besatzung eines Kampfschiffes, die das Aufstoppen beobachtet. Beim Kampf an Land werden Maschinen analog dem kombinierten Einsatz von Panzern und Infanterie von Soldaten unterstützt. Soldaten können sich ergebende oder kampfunfähige Gegner erkennen und in Gefangenschaft nehmen und damit die Möglichkeit der Einhaltung des HVR gewährleisten.

Aus Sicht der vier Hauptregeln des HVR gilt: Maschinen müssen jederzeit unter Kontrolle gebracht werden können und dürfen nicht unterschiedslos töten. Die oben aufgelisteten Systeme stellen an sich keine Verletzung der Regeln des HVR dar, es kommt jedoch auf ihren Gebrauch an.

Kriegsschiff oder nicht?

Die Untersuchung, ob der Sea Hunter ein Kriegsschiff im Sinne des Seerechtsübereinkommens (SRÜ) ist, zeigt, dass völkerrechtliche Probleme an eher unerwarteten Stellen auftauchen. Die United Nations Convention on the Law of the Sea (UNCLOS III) von 1982 definiert in Artikel 29 Kriegsschiffe so: „For the purposes of this Convention, ‚warship’ means a ship belonging to the armed forces of a State bearing the external marks distinguishing such ships of its nationality, under the command of an officer duly commissioned by the government of the State and whose name appears in the appropriate service list or its equivalent, and manned by a crew which is under regular armed forces discipline.“

Maritime Drohnen sind seit Jahrzehnten weltweit im Einsatz als Subsysteme von Kriegsschiffen, von denen sie zeitlich und räumlich begrenzt eingesetzt werden. Hierzu gehören die Minenjagd-Tauchdrohnen der Deutschen Marine vom Typ Pinguin oder Seehund. Ein System wie Sea Hunter konnte man sich in den 1970er-Jahren, der Entstehungszeit des SRÜ, noch nicht vorstellen – es ist kein Subsystem eines Kriegsschiffes. Von den drei Bedingungen des Artikels 29 ist die Kennzeichnung am leichtesten zu erfüllen. Die Unterstellung unter den Befehl eines Offiziers ebenfalls – damit ist unstreitig Befehlsgewalt gemeint. Nicht zwingend ist dafür im Zeitalter der Datenfernübertragung die Anwesenheit des Offiziers an Bord. Bei der Formulierung des SRÜ – „manned by a crew“ – ist man sicher davon ausgegangen, dass sich eine Besatzung faktisch immer an Bord „ihres“ Schiffes befindet. Damit ist eine klare Anforderung gegeben, aber auch eine ungewollt durch technischen Fortschritt entstandene Regelungslücke, die per Analogie aufgefüllt werden kann. So kann man den Sea Hunter als Kriegsschiff bezeichnen. Das wird umstritten sein unter den Staaten, denn mit der Eigenschaft verbinden sich verschiedene Verhaltenspflichten und Befugnisse, etwa bei der Durchfahrt durch fremde Hoheitsgewässer.

Unbemannte Systeme und Ethik

Mit zunehmend automatisierten Systemen haben es Soldaten schon seit langem zu tun, absehbar werden aber deren Reichweite, Aktionstempo und Handlungsoptionen weiter gesteigert. Flugkörperabwehrsysteme und andere Maschinen machen den Soldaten zunehmend zum Beobachter und Kontrolleur des Systems, der nur noch bei Abweichungen von der Norm aktiv wird. Durch Verwendung von fahrenden, fliegenden, schwimmenden oder tauchenden Drohnen werden Soldaten aus der vorderen Schusslinie zurückgezogen, was allerdings durch Distanzwaffen wieder ausgeglichen wird. Dennoch gilt: Typische Risiken des Soldatenberufs verändern sich qualitativ und quantitativ mit dem zunehmenden Gebrauch maschineller Systeme.

Unter Beschuss durch gegnerische automatisierte Systeme entsteht beim Soldaten zwangsläufig eine neue Wahrnehmung. Wenn in der angreifenden gegnerischen Maschine kein Soldat mehr kämpft und klar wird, dass man selbst Leib und Leben riskiert und auf der Gegenseite nur Sachbeschädigung bewirken kann, wird dies nicht ohne Auswirkung auf Motivation und mentale Haltung bleiben. Möglicherweise bewirkt die Erkenntnis, dass man nur leicht ersetzbares technisches Gerät zerstört und sowohl Härte als auch Opferbereitschaft keinen Vorteil mehr bieten, eine Minderung der Einsatzmotivation. Andererseits entfällt die Tötungshemmung und auch über rechtliche oder ethische Fragen des Mitteleinsatzes muss sich der Soldat nicht sorgen, es sei denn, es käme zur Wahl von Mitteln, die in ihrer Wirkung über die Bekämpfung der gegnerischen Maschinen hinausreichen. Macht es ethisch einen Unterschied, wenn man als Soldat von einer automatisiert handelnden Maschine beschossen wird? Es bedeutet keinen Unterschied im Hinblick auf die nicht vorhersehbaren Zufälle im Kampf. Es macht Verletzungen, Qualen, Leiden oder Tod aus Sicht des Soldaten weder besser noch schlechter.

Dass technische Systeme in der Zukunft einmal die Entscheidungen über das „Ob“ und „Was“ eines Waffeneinsatzes fällen können, kann nicht ganz ausgeschlossen werden. Auch wenn es technologisch aktuell noch deutliche Limits gibt, liegt das im Bereich des Möglichen – unabhängig davon, ob diese Verantwortung dann tatsächlich an solche Systeme delegiert wird. Macht es ethisch einen Unterschied, ob man als Soldat über Beginn und Ende einer Gewaltanwendung entscheidet, die Maschine lediglich dabei beobachtet oder sich sogar ganz heraushält aus dem Prozess? Sicher ja. Es ist Kern des Soldatenberufs, genau diese schwierige Entscheidung zu treffen und sie nicht an Maschinen zu delegieren. Wenn Menschen existenzielle Entscheidungen treffen unter Einbeziehung von Ethik und Emotion schwingt immer die eigene Verwundbarkeit und Sterblichkeit mit – keine Maschine wird das je simulieren können, weil Entscheidungen von Menschen immer auch gefühlt werden und nicht nur intellektuell als abstrakter Gedankengang entstehen. Die Verantwortung über letale Entscheidungen muss immer beim Menschen verbleiben, der sich seiner eigenen Verwundbarkeit und Sterblichkeit bewusst ist, gerade weil diese Entscheidung nicht nur für den Gegner existenziell ist oder zumindest sein kann.

Es stellt sich eine weitere dringende ethische Frage: Kann es die Führung einer Konfliktpartei verantworten, ihre Soldaten gegen unbemannte Systeme antreten zu lassen, wenn sie ihre Streitkräfte mit keinen oder mit deutlich weniger unbemannten Systemen als der Gegner ausrüstet? In dem Wissen, dass die Maschinen allein durch ihre schnelleren Entscheidungsschleifen im Vorteil sind. In dem Wissen, dass der Gegner die zerstörten Maschinen ersetzen kann, die eigenen gefallenen oder kriegsversehrten Soldaten aber endgültig verloren oder aus dem Kampf herauszunehmen sind. In dem Wissen, dass man bei der Verteidigung des eigenen Landes möglicherweise ganze Generationen „verheizt“ gegen die ständig nachproduzierten Systeme des Gegners. In dem Wissen, dass die eigenen Soldaten die eigene Zivilbevölkerung so nicht hinreichend schützen können.

Dieser Beitrag ist ein Auszug aus dem neuen Buch Unbemannte Systeme und Cyberoperationen: Streitkräfte und Konflikt im 21. Jahrhundert – Eine Einführung von Dr. Michael Stehr, Mittler im Maximilian Verlag, Hamburg 2020, ISBN 978-3-8132-1103-0